数据燃料 驱动AI大模型落地的核心挑战与集成服务之道

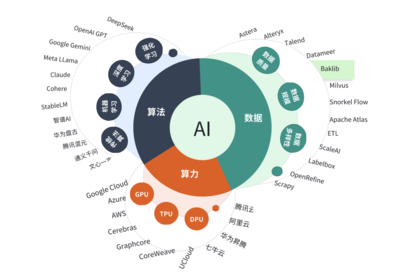

在人工智能的浪潮中,大规模预训练模型(AI大模型)已成为推动技术进步与产业革新的关键引擎。当理论的光辉照进现实的土壤,一个愈发清晰的共识正在形成:AI大模型的真正困境,往往不在于模型架构的精妙或算力的浩瀚,而在于其赖以生存的根基——数据。它不仅是模型的“燃料”,更是决定其能否在千行百业中成功落地的“命脉”。与此专业的人工智能行业应用系统集成服务,正成为架起数据燃料与行业价值之间桥梁的不可或缺的工程力量。

一、数据的困境:从“燃料”稀缺到“适配”难题

- 高质量数据的稀缺性:大模型的训练需要海量、高质量、多样化的数据。然而在专业领域(如医疗、金融、工业制造),这类数据往往分散、封闭、标注成本极高,且涉及严格的隐私与合规要求。通用互联网数据虽多,却难以直接满足垂直领域的深度需求,导致模型在专业场景中“巧妇难为无米之炊”。

- 数据与场景的“适配”鸿沟:拥有数据不等于拥有可用的“燃料”。原始数据通常杂乱、充满噪声,且其分布与目标业务场景存在偏差。如何清洗、标注、增强数据,并构建能真实反映业务逻辑的数据集,是将“原材料”转化为“高能燃料”的复杂过程。许多大模型在实验室表现优异,却因数据与场景脱节而在实际应用中表现不佳。

- 数据持续供给与演化的挑战:行业知识与应用环境在不断变化,模型需要持续学习与迭代。这意味着数据“燃料”的供给不能是一次性的,而需要建立持续、安全、高效的数据获取、更新与回流机制。如何构建这一动态数据生态,是保持模型生命力和竞争力的长期挑战。

二、系统集成服务:将“燃料”转化为“动力”的工程学

面对数据困境,单纯的算法研究已不足够。将AI大模型成功部署到具体行业,需要一整套人工智能行业应用系统集成服务。这项服务旨在解决从数据、模型到业务系统的“最后一公里”问题,其核心价值在于:

- 数据治理与工程化解决方案:集成服务商帮助客户梳理数据资产,设计数据采集、清洗、标注的标准流程,利用工具链提升数据准备效率。更重要的是,他们能结合行业知识,构建面向特定任务(如设备故障预测、金融风控、医疗影像分析)的领域数据集,确保“燃料”的高质量与高适配性。

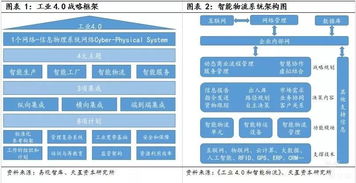

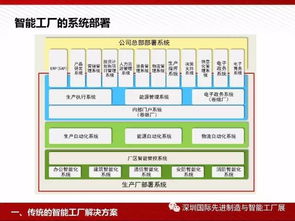

- 模型定制、优化与部署集成:基于处理后的领域数据,对通用大模型进行微调、蒸馏或从头训练,打造专属的行业模型。将其与客户现有的IT系统(如ERP、CRM、MES)、硬件设备(如传感器、机器人)及业务流程进行深度集成,确保模型能力能无缝嵌入业务闭环,真正产生价值。

- 构建持续运维与进化体系:提供包括模型性能监控、数据漂移检测、自动化再训练、版本管理在内的全生命周期运维服务。确保模型能够随着新数据的流入而持续优化,适应业务变化,形成“数据驱动模型优化,模型应用反哺数据积累”的良性循环。

- 应对安全、合规与伦理挑战:专业的集成服务包含数据安全传输与加密、隐私计算(如联邦学习)、模型可解释性增强、输出结果合规性校验等关键环节,帮助客户在享受AI红利的有效管控风险。

三、未来展望:走向深度融合的智能生态

未来的竞争,将不仅是AI大模型本身的竞争,更是“高质量数据生态”与“深度系统集成能力”的结合体竞争。企业需要更积极地看待自身数据资产,并与具备行业知识和工程化能力的集成服务伙伴紧密合作。

一方面,数据湖、知识图谱、隐私计算等技术的发展,将提升数据“燃料”的提炼效率与安全性。另一方面,低代码/无代码的AI开发平台、云原生AI服务将与集成服务深度融合,降低AI应用的门槛,加速大模型在更多细分场景的落地。

总而言之,破解AI大模型的困境,必须正视数据这一核心“燃料”问题,并依靠专业的行业应用系统集成服务,完成从技术潜能到商业价值的艰难一跃。只有当数据管道畅通无阻,集成工程扎实稳健,人工智能的巨轮才能在行业的深海中,获得持续而强劲的动力。

如若转载,请注明出处:http://www.kenqlirc.com/product/18.html

更新时间:2026-05-18 23:31:42